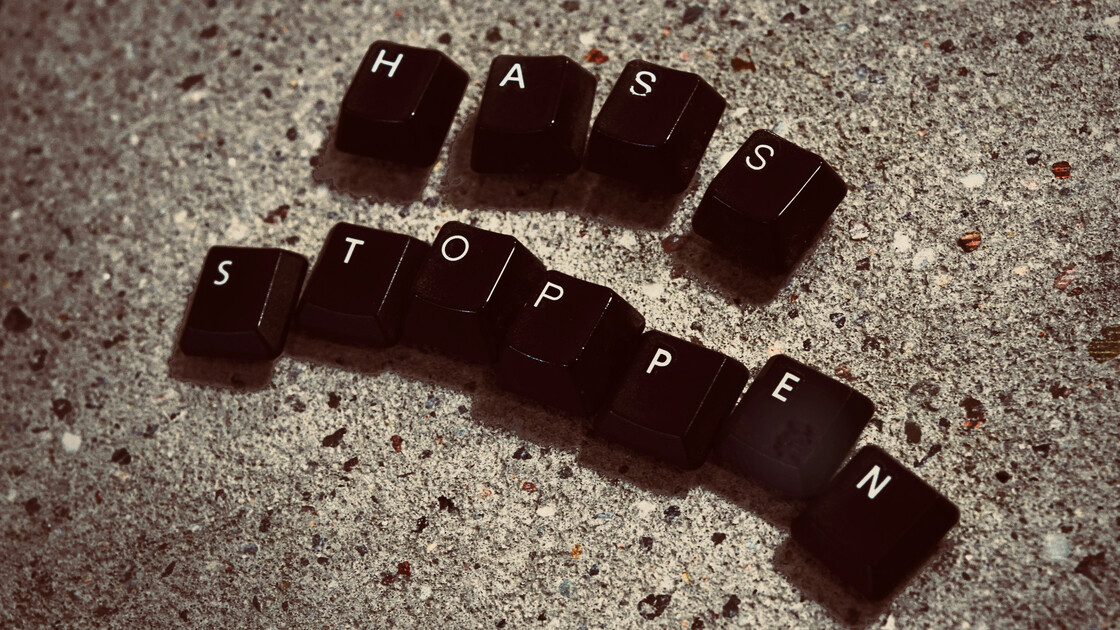

Soziale Medien Hate Speech: Was tun bei Hass im Internet?

Von einem Tag auf den anderen explodiert Hate Speech auf dem Facebook-Kanal einer großen NGO.

wegewerk unterstützt daraufhin das Redaktionsteam mit analytischen und strategischen Mitteln. Ein Erfahrungsbericht zum Umgang mit Hass, Rechtspopulismus und Menschenfeindlichkeit in den Sozialen Medien.

Inmitten des Bundestagswahlkampfes 2017 erreichte uns eine kurzfristige Anfrage eines Kunden: In der aufgeheizten Atmosphäre des Wahlkampfs hatte ein Facebook-Post der NGO für beachtlichen Wirbel gesorgt. Binnen weniger Stunden war der Beitrag viral explodiert und hatte eine große Anzahl fremdenfeindlicher und menschenverachtender Nutzer*innen angezogen, die sich in der Kommentarsektion erbitterte Auseinandersetzungen mit den Unterstützer*innen und dem Moderationsteam der NGO lieferten.

Als sich die erste Aufregung ein wenig gelegt hatte, beauftragte die NGO wegewerk mit der Analyse des Vorfalls. Was war gut gelaufen, was nicht? Wo hätten bessere Vorbereitung, andere Kommunikationsstrategien oder ein anderes Verhalten der Social-Media-Redaktion die hitzige Debatte positiv beeinflussen können? Mithilfe qualitativer und quantitativer Methoden wie Sprach-, Debatten- und Narrativ-Analysen konnten wir diese und weitere Fragen unseres Kunden stichhaltig beantworten – und dabei wertvolle Einsichten in die Funktionsmechanismen von Hate Speech und die Effektivität unterschiedlicher Counter-Strategien gewinnen.

Auch wenn wir Details unserer Analyse selbstverständlich nicht veröffentlichen können, gab es dennoch einige allgemeine Erkenntnisse über die Qualität und den Verlauf viral verlaufender Hate Speech-Vorkommnisse auf Facebook, die wir gerne mit allen Interessierten teilen möchten:

1. Auch eine relativ geringe Zahl von Hassern kann für viel Unruhe sorgen.

Inmitten der viralen Auseinandersetzung kam in der Social-Media-Redaktion der NGO das Gefühl auf, von negativen, hasserfüllten Posts geradezu überwältigt zu werden. Die Analyse mit etwas Abstand ergab jedoch, dass weit mehr Nutzer*innen sich in der Debatte positiv und unterstützend gegenüber der NGO und ihren Zielen äußerten. Der Eindruck der Redaktion war dennoch nicht falsch: Unserer Analyse zufolge waren die negativen Kommentator*innen im Schnitt dreimal so aktiv. Während positiv gesinnte Nutzer*innen üblicherweise genau einen Kommentar verfassen, beißen sich viele Hasser geradezu an der Debatte fest und posten immer wieder. Social-Media-Redaktionen sind gut damit beraten, solche Nutzer*innen schnell zu identifizieren und – z. B. nach einer einmaligen, öffentlichen Warnung – zu sperren.

2. Unsachliche Posts vergiften das komplette Diskussionsklima – auf beiden Seiten.

In der Analyse zeigte sich, dass einige wenige aggressiv-polemische Posts der Gegenseite ausreichen, um auch die eigene Community zu emotionalerem Kommunikationsverhalten anzustacheln. Hier ist frühes und entschiedenes Eingreifen der Moderation essenziell, um die Debattenkultur auf dem Kanal insgesamt zu schützen. Wir raten dazu, auch Unterstützer*innen, die ausfällig gegen die Gegenseite werden, schnell und unmissverständlich begreiflich zu machen, wo die Grenzen der akzeptierten Kommunikation liegen – und diese im Zweifel genauso konsequent zu sperren wie Kommentierende der Gegenseite.

3. Die Eins-zu-eins-Kommunikation mit Unterstützer*innen ist zentral.

Während einer Hate Speech-Attacke fühlt sich die Auseinandersetzung mit Anfeindungen und polemischer Kritik natürlich dringender an als die „übliche“ Nutzer*innenbindung auf der unterstützenden Seite. Doch gerade jetzt kann echte, tiefer gehende Bindung entstehen: Wenn Kommentierende, die sich in einer Krisensituation auf die Seite der Kanalinhaber stellen, dafür ein direktes und persönliches „Danke“ bekommen, ist das viel mehr wert als jede Online-Interaktion außerhalb einer Krisenphase.

4. Vorbereitung ist die halbe Miete.

Niemand kann voraussehen, wann und bei welchem Inhalt sich plötzlich viraler Hass auf dem Facebook-Auftritt einer Organisation entlädt – das macht den viralen Hass ja so unheimlich. Wir empfehlen daher jeder Organisation, die einen oder mehrere öffentliche Social-Media-Kanäle betreibt, ihrer Redaktion so früh wie möglich die passenden Hilfsmittel für eine solche Situation an die Hand zu geben. Dazu gehören zum einen eine verschriftlichte und öffentlich zugängliche Netiquette, auf welche die Redaktion bei Übertretungen seitens der Community direkt verweisen kann. Genauso wichtig sind aber auch Argumentarien, in denen die wichtigsten Argumente zu konfliktträchtigen Themen prägnant und überzeugend zusammengefasst sind, sowie Leitfäden, die der Redaktion klare Regeln für den Umgang mit Hass und unsachlicher Kommunikation an die Hand geben.

5. Auch Hass erhöht die Reichweite.

Niemand liest gerne negative Kommentare auf der eigenen Facebook-Wall, und positive Viral-Effekte sind selbstredend einem „Hatestorm“ allemal vorzuziehen. Aber: Bei aller berechtigten Sorge angesichts von digitalem Hass kann selbst einem Hate Speech-Ereignis etwas Positives abgewonnen werden. Denn Facebook differenziert nicht zwischen positiver und negativer Interaktion – und Interaktion steigert bekanntlich die Reichweite. Bei aller Belastung und Vorsicht im Falle einer viralen Hass-Attacke sollten Kommunikationsprofis daher auch nicht die Chance übersehen, die in der sprunghaft angestiegenen Reichweite liegt. Wenn es der Social-Media-Redaktion gelingt, in der erhitzten Debatte die Oberhand zu behalten, klar und souverän die Standpunkte der Organisation zu kommunizieren und ein gutes Maß bei der Sperrung rechtlich relevanter und unsachlicher Beiträge zu finden, kann ein Hatestorm im Ergebnis sogar positive Auswirkungen auf das Social-Media-Profil und die öffentliche Wahrnehmung des Seiteninhabers haben. Eine gute Vorbereitung – siehe Punkt 4 – ist hier die halbe Miete.

6. Social-Media-Redakteur*innen sind Menschen.

Zu guter Letzt darf eines auf keinen Fall vergessen werden: Hass und Anfeindungen wirken sich auf die Psyche aus. Redakteur*innen, die mit einem Hatestorm konfrontiert sind, sollten dementsprechend Unterstützung erhalten. Ein Austausch mit Kolleg*innen kann hier erste Abhilfe verschaffen – Redakteur*innen sind zumindest nicht alleine mit ihren Erfahrungen. Das sollte das Team berücksichtigen und Gespräche anbieten. Sind Menschen über einen längeren Zeitraum mit Online-Hass konfrontiert, sollten auch weitergehende Maßnahmen wie die vorübergehende psychologische Betreuung in Betracht gezogen werden – am besten in direkter und vertrauensvoller Absprache mit den Betroffenen.